Les progrès fulgurants de l’intelligence artificielle, notamment dans le domaine du deep learning, ont indéniablement redéfini notre façon de consommer et de comprendre l’information.

Au coeur de ces avancées puissantes se trouvent les deepfakes et hypertrucages, des technologies révolutionnaires qui maîtrisent la manipulation d’images, de vidéos, d’enregistrements audio et de textes avec une précision et un réalisme impressionnants.

Une révolution technologique incontournable

Initialement développées pour des applications créatives telles que les effets spéciaux au cinéma, ces technologies ont transcendu des frontières inquiétantes, donnant naissance à des outils de manipulation numérique puissants. Ce qui était autrefois perçu comme de la science-fiction est désormais une réalité à la portée de tous, engendrant des conséquences majeures sur la confiance du public dans l’information.

Ce phénomène a déjà des répercussions significatives sur notre capacité à discerner la vérité, et son extension dans des domaines variés tels que le divertissement, le doublage et la diffusion de l’information représente une menace sérieuse pour la démocratie.

Dorénavant, nous nous retrouvons plongés dans une ère où le réel et le virtuel s’entrelacent de manière exponentielle, redéfinissant notre perception du monde avec audace.

Qu’est ce qu’un deepfake ?

Le deepfake est une technologie qui s’appuie sur les réseaux antagonistes génératifs (GANs), un système d’intelligence artificielle qui apprend à créer des images ou des vidéos réalistes en s’entraînant sur un grand nombre de données.

Cette technologie permet ainsi de faire dire ou faire faire à une personne des choses qu’elle n’a jamais dites ou faites, simplement en manipulant des vidéos et des audio.

Pour en savoir plus sur les GANs et leur fonctionnement : https://datascientest.com/generative-adversarial-network-tout-savoir

Une menace grandissante pour l’information et la démocratie

Les deepfakes ont déjà démontré l’ampleur de leurs répercussions sur divers domaines, notamment :

➤ Désinformation et manipulation politique

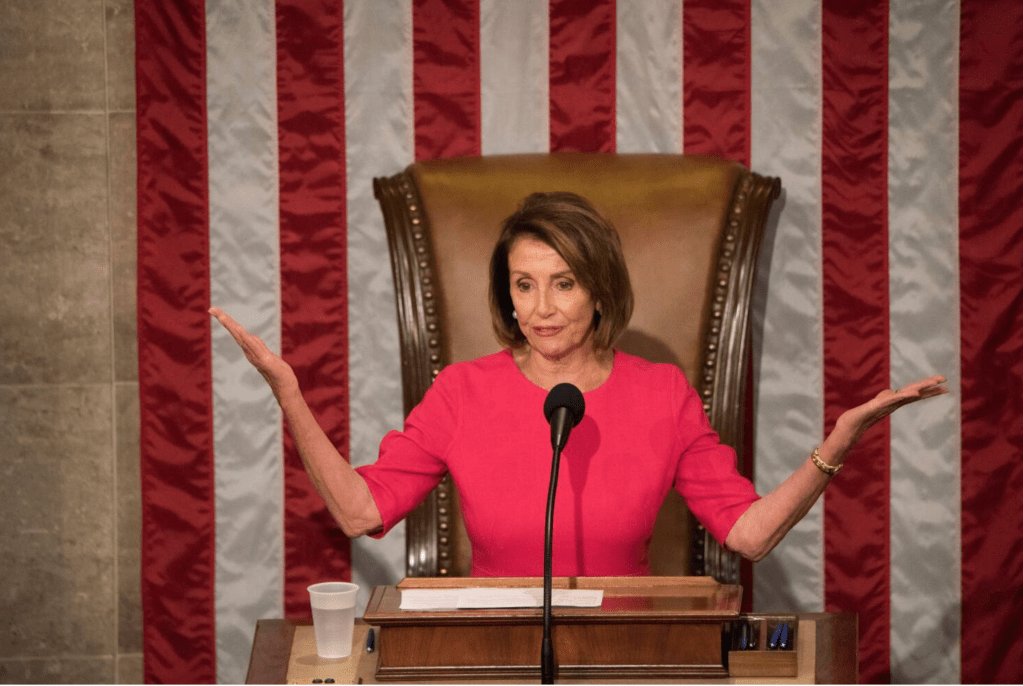

Parmi les cas les plus médiatisés, on peut citer celui de Nancy Pelosi, alors présidente de la Chambre des représentants des États-Unis en 2019, dont la voix a été ralentie pour laisser croire qu’elle parlait sous l’effet de l’alcool ou de la fatigue. Malgré la dénonciation de cette supercherie, la vidéo a été largement diffusée, notamment par des personnalités politiques influentes, renforçant ainsi la défiance envers les médias et les institutions.

Ce sont des procédés de manipulation qui peuvent avoir un impact significatif, non seulement sur l’image des personnalités publiques, mais également sur la perception que le public a de la politique en général.

Nous pouvons aussi prendre l’exemple des élections de 2020 en Inde. Le parti politique Bharatiya Janata Party (BJP) a brillamment utilisé cette technologie afin de créer une vidéo du politicien Manoj Tiwari. Dans celle-ci, on le voit parler couramment plusieurs langues locales, ce qui a grandement contribué à renforcer l’impact de son message sur son électorat en touchant diverses communautés.

Bien que cette utilisation puisse sembler douteuse, elle démontre clairement comment cette technologie est habilement exploitée pour façonner l’opinion publique.

➤ Cybercriminalité et escroqueries

En 2019, un individu malintentionné a habilement utilisé un deepfake vocal pour se faire passer pour le PDG d’une entreprise britannique, réussissant à obtenir un virement bancaire de 220 000 euros. La victime, persuadée de parler à son supérieur, a effectué la transaction sans le moindre doute.

C’est une situation qui met en lumière les risques indéniables associés à l’utilisation de ces technologies dans le cadre des fraudes financières.

En France, la gendarmerie nationale met en évidence une hausse alarmante des cas d’escroqueries utilisant des faux visages et des identités fictives, notamment dans les fraudes à la carte bancaire et le chantage en ligne.

➤ Un fléau pour la vie privée des célébrités

Les célébrités sont également fréquemment ciblées par les deepfakes, ce qui nuit durablement à leur réputation.

Début 2025, un incident marquant a captivé les médias : Anne, une femme française de 53 ans, a été victime d’une escroquerie impliquant un deepfake de Brad Pitt. Convaincue qu’elle échangeait avec l’acteur grâce à des messages et des vidéos où il semblait lui parler directement, elle a finalement versé plusieurs milliers d’euros avant de réaliser qu’elle avait été manipulée par un escroc.

Un autre cas plus grave concerne l’utilisation de deepfakes pour créer des contenus pornographiques non consentis, et nous ne pouvons qu’imaginer les répercussions que cela peut avoir sur les victimes. Il faut garder à l’esprit que celles-ci, souvent des femmes, se retrouvent parfois dans des situations qu’elles n’auraient jamais imaginées, cela ayant des conséquences dévastatrices sur leur vie personnelle et professionnelle.

https://www.arte.tv/fr/videos/119514-000-A/le-cauchemar-des-deepfakes-pornographiques/

Quelles sont les mesures envisagées pour lutter contre les deepfakes ?

Face à ce risque, plusieurs actions sont mises en oeuvre pour limiter l’impact des deepfakes.

➤ Développement des détecteurs d’IA

Des entreprises comme Microsoft sont à la pointe du développement de solutions puissantes pour détecter les signes de falsification dans les vidéos. Ces outils de détection sont désormais incontournables dans la lutte contre les manipulations en ligne et jouent un rôle clé dans la prévention de toute forme de malveillance.

➤ Régulation et cadre juridique

C’est précisément pour cette raison que la France a récemment renforcé ses lois les concernant, ouvrant ainsi la voie à un cadre juridique ambitieux et déterminé pour lutter efficacement contre ce fléau.

Par ailleurs, l’Union européenne prend des mesures audacieuses en incluant les deepfakes dans son Digital Services Act, avec l’objectif clair d’imposer aux plateformes la responsabilité de signaler les contenus manipulés.

L’ONU, quant à elle, affirme son engagement en adoptant une résolution forte pour réguler l’IA et préserver l’intégrité du débat public.

➤ Sensibilisation du public

La sensibilisation est plus que jamais un enjeu décisif dans cette lutte contre les deepfakes et les hypertrucages.

La CNIL propose une série de ressources indispensables pour informer le public sur l’utilisation responsable de l’intelligence artificielle et pour aider à identifier les deepfakes. Cette éducation, nous la devons à la vigilance de tous pour éviter la propagation de ces vidéos truquées de plus en plus répandues.

Quel avenir pour la confiance dans l’information ?

À mesure que l’intelligence artificielle devient de plus en plus performante, la rivalité entre les créateurs de deepfakes et les experts en cybersécurité s’intensifie. Dans ce contexte, des chercheurs se consacrent avec détermination au développement de watermarks invisibles pour authentifier les vidéos, tandis que d’autres proposent avec assurance l’intégration de l’IA dans le journalisme, mettant en place des algorithmes capables de vérifier l’authenticité des contenus avant leur diffusion.

Nous pouvons désormais nous demander ➤ Comment les gouvernements pourront-ils à la fois encourager les innovations technologiques et protéger les utilisateurs contre les deepfakes ?

➤ Quelle est réellement la responsabilité des plateformes en ligne dans la détection et la suppression des contenus manipulés ?

➤ Comment former efficacement le public, en particulier les jeunes et les personnes âgées, à identifier et à se prémunir contre les deepfakes ?

Ci-joint les sources sélectionnées pour l’élaboration de cet article :

Article écrit par Cristiana Rodrigues

Laisser un commentaire